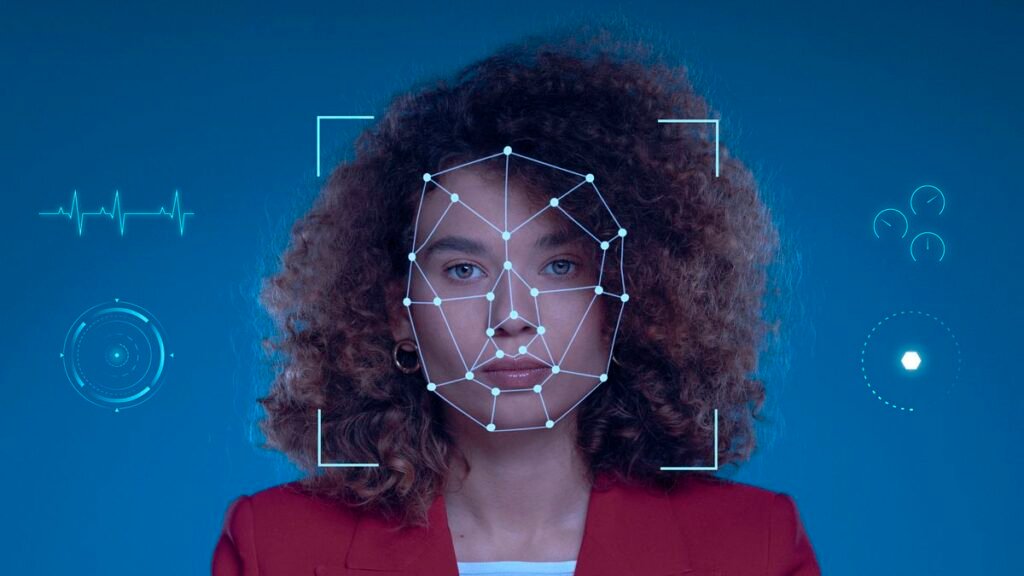

Golpes com Reconhecimento Facial: Como Operam e Proteção Empresarial

Contexto

No mundo digital atual, a biometria é uma forma cada vez mais comum de autenticação em dispositivos e serviços. Segundo dados da Accenture, 73% dos brasileiros preferem usar impressões digitais, reconhecimento facial e voz para acessar seus aparelhos e contas pessoais. Essa tendência é impulsionada pela facilidade e segurança oferecidas por esses métodos.

No entanto, a adoção da biometria não está isenta de riscos. Golpistas estão se adaptando e desenvolvendo novas estratégias para burlar sistemas biométricos, com destaque para o uso de deepfakes e outros tipos de técnicas sofisticadas.

Como acontecem os golpes com reconhecimento facial

Anchises Moraes, Head de Threat Intelligence na Apura Cyber Intelligence, destaca que a evolução das tecnologias biométricas reforça sistemas de segurança governamentais e privados. No entanto, isso também oferece novas oportunidades para cibercriminosos.

As empresas dividem as iniciativas para burlar biometria em cinco níveis de complexidade:

- Nível 1: Usam fotos digitais em alta resolução, vídeos em HD e máscaras de papel.

- Nível 2: Criam bonecos realistas com cara de pessoas reais para enganar os sistemas biométricos.

- Nível 3: Utilizam software de deepfake para alterar imagens ou vídeos.

- Nível 4: Empregam técnicas avançadas de inteligência artificial e realidade virtual para criar réplicas digitais.

- Nível 5: Aplicam métodos de engenharia social e manipulação psicológica para obter informações pessoais necessárias.

Repercussão

A crescente utilização da biometria em dispositivos móveis e transações digitais chama a atenção de organizações especializadas. A Juniper Research prevê que, até 2026, 57% das transações digitais do mundo sejam validadas por métodos biométricos.

Diante desse cenário, a preocupação com a segurança desses sistemas é cada vez maior. Empresas como Apura Cyber Intelligence e outros especialistas estão desenvolvendo soluções inovadoras para mitigar esses riscos, implementando medidas de proteção mais robustas.

O que vem agora

Com a crescente sofisticação dos golpes com reconhecimento facial, as empresas estão tomando medidas proativas. Isso inclui a implementação de múltiplas camadas de autenticação e a integração de inteligência artificial para detectar comportamentos suspeitos.

Além disso, há um foco em educação do usuário, com orientações sobre práticas de segurança e alertas sobre possíveis tentativas de golpes. A colaboração entre especialistas em cibersegurança, órgãos governamentais e empresas privadas é essencial para avançar na proteção desses sistemas.

Fontes

Fontes

- —

Este artigo foi redigido com apoio de ferramentas de IA e revisado por nossa equipe. Citamos as fontes originais e seguimos as políticas do Google Notícias.